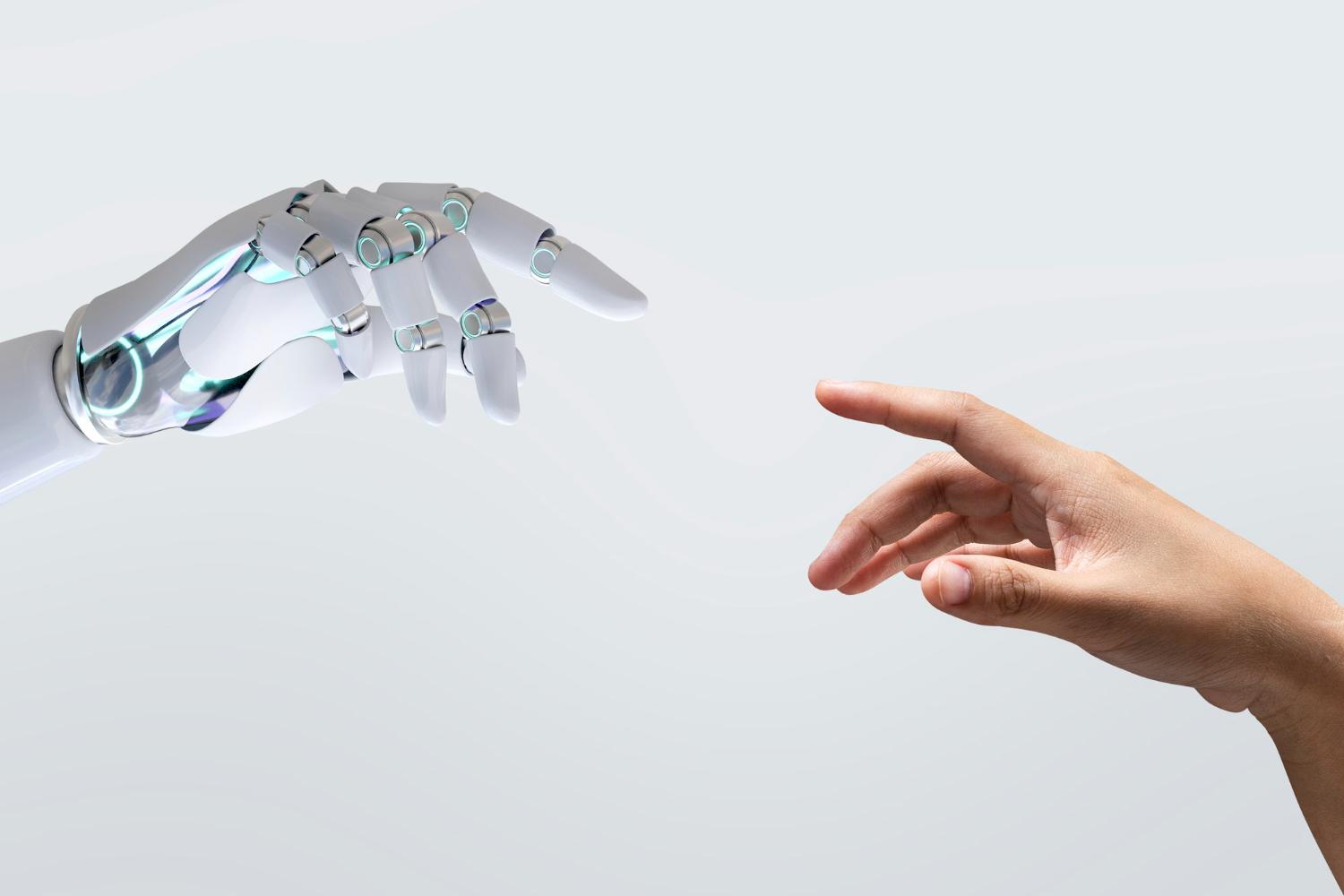

Τον Μάιο, εκατοντάδες κορυφαίες προσωπικότητες της τεχνητής νοημοσύνης εξέδωσαν μια κοινή ανακοίνωση περιγράφοντας την υπαρξιακή απειλή της τεχνολογίας που βοήθησαν να δημιουργηθεί για την ανθρωπότητα.

«Ο μετριασμός του κινδύνου αφανισμού από την τεχνητή νοημοσύνη θα πρέπει να αποτελεί παγκόσμια προτεραιότητα», ανέφερε, «παράλληλα με άλλους κινδύνους κοινωνικής κλίμακας, όπως οι πανδημίες και ο πυρηνικός πόλεμος».

Αυτή η φράση που επικαλείται την απειλή του αφανισμού του ανθρώπου, την οποία υπογράφουν εκατοντάδες διευθυντικά στελέχη και επιστήμονες από εταιρείες όπως οι OpenAI, DeepMind της Google, Anthropic και Microsoft, έγινε πρωτοσέλιδο παγκοσμίως.

Αυτό που ώθησε όλους αυτούς τους ειδικούς να μιλήσουν ήταν οι προσδοκίες υπόσχεση, αλλά και ο κίνδυνος, από την γενετική τεχνητή νοημοσύνη, ενός τύπου τεχνολογίας που μπορεί να επεξεργαστεί και να δημιουργήσει τεράστιες ποσότητες δεδομένων.

Τεχνητή νοημοσύνη: Τα παραγόμενα έργα τέχνης εκτός προστασίας νόμου περί πνευματικής ιδιοκτησίας

Η κυκλοφορία του ChatGPT από την OpenAI τον Νοέμβριο προκάλεσε ένα ξέσπασμα πυρετωδών ενθουσιασμών καθώς απέδειξε την ικανότητα των μεγάλων γλωσσικών μοντέλων, της τεχνολογίας πίσω από το chatbot, να δημιουργούν πειστικά αποσπάσματα κειμένου, να γράφουν δοκίμια ή να βελτιώσουν τα email σας.

Δημιούργησε μια κούρσα ανταγωνισμού μεταξύ εταιρειών του κλάδου στην προσπάθεια να λανσάρουν τα δικά τους εργαλεία παραγωγής τεχνητής νοημοσύνης για τους καταναλωτές που θα μπορούσαν να δημιουργήσουν κείμενο και ρεαλιστικές εικόνες.

Ο ντόρος γύρω από την τεχνολογία έχει επίσης οδηγήσει σε αυξημένη συνειδητοποίηση των κινδύνων της: τη δυνατότητα δημιουργίας και διάδοσης παραπληροφόρησης καθώς πλησιάζουν οι δημοκρατικές εκλογές. την ικανότητά του να αντικαθιστά ή να μεταμορφώνει θέσεις εργασίας, ειδικά στις δημιουργικές βιομηχανίες· και τον λιγότερο άμεσο κίνδυνο να γίνει πιο έξυπνο από τους ανθρώπους και να τους αντικαταστήσει.

Οι ρυθμιστικές αρχές και οι εταιρείες τεχνολογίας έχουν εκφράσει εμφατικά την ανάγκη να ελέγχεται η τεχνητή νοημοσύνη, αλλά οι ιδέες σχετικά με τον τρόπο ρύθμισης των μοντέλων και των δημιουργών τους διέφεραν ευρέως ανά περιοχή.

Η ΕΕ έχει συντάξει σκληρά μέτρα σχετικά με τη χρήση της τεχνητής νοημοσύνης που θα βαρύνουν τις εταιρείες τεχνολογίας για να διασφαλίσουν ότι τα μοντέλα τους δεν παραβιάζουν τους κανόνες. Έχουν προχωρήσει πολύ πιο γρήγορα από τις ΗΠΑ, όπου οι νομοθέτες προετοιμάζουν μια ευρεία αναθεώρηση της τεχνητής νοημοσύνης για να καθορίσουν πρώτα ποια στοιχεία της τεχνολογίας ενδέχεται να πρέπει να υπόκεινται σε νέα ρύθμιση και τι μπορεί να καλύπτεται από τους υπάρχοντες νόμους.

Το Ηνωμένο Βασίλειο, εν τω μεταξύ, επιχειρεί να χρησιμοποιήσει τη νέα του θέση εκτός ΕΕ για να δημιουργήσει το δικό του πιο ευέλικτο καθεστώς που θα ρυθμίζει τις εφαρμογές της τεχνητής νοημοσύνης ανά τομέα και όχι το λογισμικό στο οποίο βρίσκονται. Τόσο η αμερικανική όσο και η βρετανική προσέγγιση αναμένεται να είναι περισσότερο υπέρ της βιομηχανίας από ό,τι ο νόμος των Βρυξελλών, ο οποίος έχει επικριθεί σφοδρά από τη βιομηχανία της τεχνολογίας.

Οι πιο αυστηροί περιορισμοί για τους δημιουργούς τεχνητής νοημοσύνης, ωστόσο, ενδέχεται να εισαχθούν από την Κίνα καθώς επιδιώκει να εξισορροπήσει τους στόχους μεταξύ του ελέγχου των πληροφοριών που διαχωρίζονται από τα παραγωγικά μοντέλα και του ανταγωνισμού στην τεχνολογική κούρσα με τις ΗΠΑ.

Αυτές οι τεράστιες αποκλίνουσες προσεγγίσεις κινδυνεύουν να δεσμεύσουν τη βιομηχανία της τεχνητής νοημοσύνης στη γραφειοκρατία, καθώς τα τοπικά καθεστώτα πρέπει να ευθυγραμμιστούν με άλλες χώρες, ώστε η τεχνολογία —η οποία δεν περιορίζεται από σύνορα— να μπορεί να ελέγχεται πλήρως.

Ορισμένοι προσπαθούν να συντονίσουν μια κοινή προσέγγιση. Τον Μάιο, οι ηγέτες των χωρών της G7 σύστησαν μια ομάδα εργασίας για την εναρμόνιση των ρυθμιστικών καθεστώτων που ονομάστηκαν Διαδικασία AI της Χιροσίμα. Θέλει να διασφαλίσει ότι η νομοθεσία είναι διαλειτουργική μεταξύ των χωρών μελών. Το Ηνωμένο Βασίλειο, εν τω μεταξύ, θα φιλοξενήσει μια παγκόσμια σύνοδο κορυφής τεχνητής νοημοσύνης τον Νοέμβριο για να συζητηθεί πώς ο διεθνής συντονισμός για τη ρύθμιση μπορεί να μετριάσει τον κίνδυνο.

Αλλά κάθε περιοχή έχει τις δικές της σταθερές ιδέες σχετικά με τον καλύτερο τρόπο ρύθμισης της τεχνητής νοημοσύνης — και οι ειδικοί προειδοποιούν ότι, καθώς η τεχνολογία εξαπλώνεται γρήγορα σε κοινή χρήση, είναι καιρός για τη μόδα μια συναίνεση έχει ήδη εξαντληθεί.

Τον Ιούλιο, ο ΟΟΣΑ προειδοποίησε ότι τα επαγγέλματα που διατρέχουν τον υψηλότερο κίνδυνο εκτόπισης της τεχνητής νοημοσύνης θα είναι θέσεις εργασίας υψηλής ειδίκευσης, εργαζομένων που θα αντιπροσωπεύουν περίπου το 27 τοις εκατό της απασχόλησης στις οικονομίες-μέλη. Η έκθεσή της τόνισε την «επείγουσα ανάγκη δράσης» και συντονισμού των απαντήσεων για «να αποφευχθεί μια κούρσα προς τα κάτω».

«Βρισκόμαστε σε ένα σημείο που [η ρύθμιση] δεν είναι πολυτέλεια», λέει ο καθηγητής David Leslie του Ινστιτούτου Alan Turing, του εθνικού ινστιτούτου του Ηνωμένου Βασιλείου για την επιστήμη των δεδομένων και την τεχνητή νοημοσύνη. «Είναι ανάγκη να υπάρξει πιο συντονισμένη διεθνής δράση εδώ γιατί οι συνέπειες της εξάπλωσης της γενετικής τεχνητής νοημοσύνης δεν είναι εθνικές, είναι παγκόσμιες».

Το φαινόμενο των Βρυξελλών

Χαρακτηριστικά, η ΕΕ ήταν η πρώτη που έκανε άλμα με τον νόμο της για την τεχνητή νοημοσύνη, ο οποίος αναμένεται να εγκριθεί πλήρως μέχρι το τέλος του έτους.

Η κίνηση μπορεί να θεωρηθεί ως μια προσπάθεια να τεθεί ένα πρότυπο προς μίμηση από άλλες χώρες, σύμφωνα με τον Ευρωπαϊκό Γενικό Κανονισμό για την Προστασία Δεδομένων, ο οποίος παρείχε ένα πλαίσιο για τους νόμους περί προστασίας δεδομένων σε όλο τον κόσμο.

Οι εργασίες για τη νομοθεσία για την τεχνητή νοημοσύνη ξεκίνησαν πριν από αρκετά χρόνια, όταν οι υπεύθυνοι χάραξης πολιτικής ήθελαν να περιορίσουν τις αλόγιστες χρήσεις της τεχνολογίας σε εφαρμογές όπως η αναγνώριση προσώπου. «Είχαμε τη διορατικότητα να διαβλέψουμε ότι η [AI] ήταν ώριμη για ρύθμιση», λέει ο Ντράγκος Τουντοράσε, ευρωβουλευτής που ηγήθηκε της ανάπτυξης των προτάσεων.

«Στη συνέχεια καταλάβαμε ότι η στόχευση των κινδύνων αντί της τεχνολογίας ήταν η καλύτερη προσέγγιση για την αποφυγή περιττών φραγμών στην καινοτομία».

Μετά από χρόνια διαβούλευσης, ωστόσο, η γενετική τεχνητή νοημοσύνη ήρθε και άλλαξε την προσέγγισή τους. Ως απάντηση στην τεχνολογία, οι ευρωβουλευτές πρότειναν μια σειρά τροπολογιών για προσθήκη στη νομοθεσία που εφαρμόζεται στα λεγόμενα μοντέλα θεμελίωσης, την υποκείμενη τεχνολογία πίσω από τα παραγωγικά προϊόντα τεχνητής νοημοσύνης.

Οι προτάσεις θα καθιστούσαν τους δημιουργούς τέτοιων μοντέλων υπεύθυνους για τον τρόπο χρήσης της τεχνολογίας τους, ακόμη και όταν κάποιος άλλος την έχει ενσωματώσει σε διαφορετικό σύστημα.

Για παράδειγμα, εάν μια άλλη εταιρεία ή προγραμματιστής επρόκειτο να χορηγήσει άδεια χρήσης ενός μοντέλου, ο αρχικός κατασκευαστής θα εξακολουθεί να είναι υπεύθυνος για τυχόν παραβάσεις του νόμου.

«Δεν θα περίμενες ο κατασκευαστής μιας γραφομηχανής να είναι υπεύθυνος για κάτι συκοφαντικό. Πρέπει να βρούμε μια λογική γραμμή εκεί, και για τα περισσότερα νομικά συστήματα, αυτή η γραμμή είναι όπου υπάρχει ένας προβλέψιμος κίνδυνος βλάβης», λέει ο Κεντ Ουόκερ, πρόεδρος παγκόσμιων υποθέσεων της Google.

Οι κατασκευαστές μοντέλων θα υποχρεωθούν επίσης να αναγνωρίσουν και να αποκαλύψουν τα δεδομένα στα οποία έχουν εκπαιδευτεί τα συστήματα για να διασφαλίσουν ότι οι κατασκευαστές περιεχομένου, όπως κειμένων ή εικόνων, αμείβονται βάσει των τροποποιήσεων.

Οι προτάσεις ώθησαν περισσότερες από 150 επιχειρήσεις να υπογράψουν επιστολή προς την Ευρωπαϊκή Επιτροπή, το κοινοβούλιο και τα κράτη μέλη τον Ιούνιο, προειδοποιώντας ότι οι προτάσεις θα μπορούσαν να «θέσουν σε κίνδυνο την ευρωπαϊκή ανταγωνιστικότητα».

Οι εταιρείες — οι οποίες κυμαίνονταν από την αυτοκινητοβιομηχανία Renault έως τη ζυθοποιία Heineken — υποστήριξαν ότι οι αλλαγές δημιούργησαν δυσανάλογο κόστος συμμόρφωσης για τις εταιρείες που αναπτύσσουν και εφαρμόζουν την τεχνολογία.

«Θα προσπαθήσουμε να συμμορφωθούμε, αλλά αν δεν μπορέσουμε να συμμορφωθούμε, θα σταματήσουμε να λειτουργούμε», είπε ξεχωριστά ο Σαμ Άλτμαν, διευθύνων σύμβουλος του OpenAI, σε δημοσιογράφους τον Μάιο, μετά τις τροπολογίες. Αργότερα έκανε πίσω, γράφοντας στο Twitter ότι η εταιρεία δεν σχεδιάζει να φύγει από την Ευρώπη.

Ο Πίτερ Σβαρτς, ανώτερος αντιπρόεδρος στρατηγικού σχεδιασμού στην εταιρεία λογισμικού Salesforce, μιλώντας με προσωπική ιδιότητα, προειδοποίησε επίσης ότι η προσέγγιση θα μπορούσε να έχει αντίκτυπο στον τρόπο λειτουργίας ορισμένων άλλων αμερικανικών εταιρειών στην περιοχή.

«[Τα ρυθμιστικά μοντέλα] θα τείνουν να ωφελούν όσους ήδη κυκλοφορούν στην αγορά. . . Θα απέκλειε τους νεοεισερχόμενους και θα ακρωτηρίαζε περισσότερο ή λιγότερο την κοινότητα ανοιχτού κώδικα», λέει ο Κρις Παντίλα, αντιπρόεδρος κυβερνητικών και ρυθμιστικών υποθέσεων της IBM.

Ο Παντίλα λέει ότι τα μοντέλα αστυνόμευσης θα μπορούσαν να ισοδυναμούν με «ρυθμιστική υπέρβαση» με «πραγματικό κίνδυνο παράπλευρων ζημιών ή ακούσιων συνεπειών», όπου οι μικρότερες εταιρείες δεν μπορούν να συμμορφωθούν και να ακολουθήσουν κλιμακωτά.

Αντίθετα, το Ηνωμένο Βασίλειο έχει περιγράψει αυτό που αποκαλεί πλαίσιο «υπερκαινοτομίας» για τη ρύθμιση της τεχνητής νοημοσύνης σε μια πολυαναμενόμενη λευκή βίβλο που δημοσιεύτηκε τον Μάρτιο.

Τώρα έχει προσκαλέσει τα ενδιαφερόμενα μέρη να μοιραστούν απόψεις σχετικά με τις προτάσεις της, με αποτέλεσμα η κυβέρνηση να ρυθμίζει τον τρόπο χρήσης των συστημάτων τεχνητής νοημοσύνης, αντί να εποπτεύει την τεχνολογία που διαθέτει. Το ΗΒ στοχεύει να δώσει στις υπάρχουσες ρυθμιστικές αρχές εξουσίες επιβολής, και έτσι ελπίζεται ότι αυτό το καθεστώς θα είναι πιο ευέλικτο και πιο γρήγορο στην εφαρμογή από εναλλακτικές λύσεις.

Ωστόσο, η κυβέρνηση δεν έχει ακόμη ανταποκριθεί στη διαβούλευση ή δεν έχει εκδώσει οδηγίες εφαρμογής στις διάφορες ρυθμιστικές αρχές του κλάδου, επομένως μπορεί να περάσουν χρόνια μέχρι να τεθεί πραγματικά σε ισχύ οποιοσδήποτε κανονισμός.

Κίνα εναντίον ΗΠΑ

Παρά τους φόβους για τη νομοθεσία στην Ευρώπη, ορισμένοι λένε ότι οι μεγαλύτεροι παίκτες του κλάδου δίνουν μεγαλύτερη προσοχή σε αυτό που κάνουν οι αντίπαλες υπερδυνάμεις του κόσμου.

«Οι εταιρείες που το κάνουν αυτό, αυτή την κούρσα εξοπλισμών είναι μεταξύ των ΗΠΑ και της Κίνας», λέει η Dame Γουέντι Χολ, συμπρόεδρος της κυβερνητικής επιθεώρησης AI το 2017 και καθηγήτρια επιστήμης υπολογιστών στο Πανεπιστήμιο του Southampton. «Η Ευρώπη, είτε μιλάτε για την ΕΕ είτε για το Ηνωμένο Βασίλειο, δεν έχει κανέναν έλεγχο σε αυτές τις εταιρείες εκτός εάν θέλουν να κάνουν εμπόριο στην Ευρώπη. Βασιζόμαστε πολύ σε αυτό που κάνουν οι κυβερνήσεις της Κίνας ή των ΗΠΑ όσον αφορά τη ρύθμιση των εταιρειών συνολικά».

Η Κίνα έχει εισαγάγει στοχευμένους κανονισμούς για διάφορες νέες τεχνολογίες, συμπεριλαμβανομένων αλγορίθμων συστάσεων και γενετικής τεχνητής νοημοσύνης, και ετοιμάζεται να συντάξει έναν ευρύτερο εθνικό νόμο για την τεχνητή νοημοσύνη τα επόμενα χρόνια.

Προτεραιότητά της είναι ο έλεγχος των πληροφοριών μέσω της ρύθμισης της τεχνητής νοημοσύνης, που αντικατοπτρίζεται στους τελευταίους κανονισμούς για την τεχνητή νοημοσύνη, οι οποίοι απαιτούν την τήρηση των «βασικών αξιών του σοσιαλισμού».

Εν τω μεταξύ, οι παραγωγοί-πάροχοι τεχνητής νοημοσύνης των οποίων τα προϊόντα μπορούν να «επηρεάσουν την κοινή γνώμη» πρέπει να υποβληθούν για έλεγχο ασφαλείας, σύμφωνα με τον κανονισμό που τέθηκε σε ισχύ τον Αύγουστο. Μια χούφτα κινεζικές εταιρείες τεχνολογίας, συμπεριλαμβανομένων των Baidu και ByteDance, έλαβαν έγκριση και παρουσίασαν τα παραγωγικά προϊόντα τεχνητής νοημοσύνης τους στο κοινό πριν από δύο εβδομάδες.

Τέτοιοι περιορισμοί θα ισχύουν επίσης για ξένες εταιρείες, καθιστώντας δύσκολη την προσφορά υπηρεσιών τεχνητής νοημοσύνης που παράγουν περιεχόμενο για καταναλωτές στην Κίνα.

Οι ΗΠΑ, εν τω μεταξύ, έχουν αφήσει μέχρι στιγμής τη βιομηχανία να αυτορυθμιστεί, με τη Microsoft, το OpenAI, την Google, την Amazon και τη Meta να υπογράφουν μια σειρά εθελοντικών δεσμεύσεων στον Λευκό Οίκο τον Ιούλιο.

Οι δεσμεύσεις περιλαμβάνουν εσωτερικές και εξωτερικές δοκιμές συστημάτων τεχνητής νοημοσύνης προτού δημοσιοποιηθούν, βοηθώντας τους ανθρώπους να εντοπίσουν περιεχόμενο που δημιουργείται από τεχνητή νοημοσύνη και δημιουργώντας αυξημένη διαφάνεια σχετικά με τις δυνατότητες και τους περιορισμούς των συστημάτων.

«Η ίδια η φύση του γεγονότος ότι είναι εθελοντικά από την πλευρά των εταιρειών [σημαίνει] ότι δεν εμποδίζουν την ικανότητα καινοτομίας σε αυτόν τον σημαντικό τομέα της νέας τεχνολογίας», λέει ο Ναθάνιελ Φικ, γενικός πρεσβευτής του αμερικανικού υπουργείου Εξωτερικών για τον κυβερνοχώρο. διαστημικής και ψηφιακής πολιτικής. «Εθελοντικά σημαίνει γρήγορα. Δεν έχουμε μια δεκαετία για να δημιουργήσουμε μια δομή διακυβέρνησης εδώ, δεδομένου του ρυθμού της τεχνολογικής προόδου. Επομένως, αυτές οι δεσμεύσεις είναι ένα πρώτο βήμα. . . Δεν είναι το τελευταίο βήμα».

Το Κογκρέσο έχει επισημάνει ότι θα ακολουθήσει μια μελετημένη αλλά προσεκτική προσέγγιση για τη δημιουργία νομοθεσίας. Τον Ιούνιο, ο ηγέτης της πλειοψηφίας στη Γερουσία, Τσακ Σούμερ, παρουσίασε ένα πλαίσιο για τη ρύθμιση της τεχνητής νοημοσύνης που θα ξεκινούσε με τα λεγόμενα «φόρουμ διορατικών γνώσεων» για να μάθουν οι νομοθέτες για την τεχνολογία από στελέχη του κλάδου, ειδικούς και ακτιβιστές.

Η κυβέρνηση του προέδρου Τζο Μπάιντεν έχει δηλώσει ότι επεξεργάζεται ένα εκτελεστικό διάταγμα για την προώθηση της «υπεύθυνης καινοτομίας», αλλά δεν είναι σαφές πότε θα υπογραφεί και ποια μέτρα θα περιλαμβάνει. Ωστόσο, είναι πιθανό να επικεντρωθεί τόσο στον περιορισμό της ικανότητας της Κίνας να αγοράζει προγράμματα τεχνητής νοημοσύνης όσο και στον καθορισμό προστατευτικών κιγκλιδωμάτων για τις αμερικανικές εταιρείες.

Γεωπολιτικές εντάσεις παίζουν επίσης στη σύνοδο κορυφής του Ηνωμένου Βασιλείου τον Νοέμβριο, καθώς η κυβέρνηση είπε ότι θα προσκαλέσει «χώρες με παρόμοιες απόψεις» να συμμετάσχουν. Μια έκθεση του Sifted ισχυρίστηκε πρόσφατα ότι η Κίνα έχει προσκληθεί, αλλά μόνο έξι από τα 27 κράτη μέλη της ΕΕ. Η κυβέρνηση αρνήθηκε να σχολιάσει.

«Πρέπει να επιτύχουμε μια ισορροπία εδώ μεταξύ των εθνικών προσεγγίσεων και της διεθνούς εναρμόνισης», λέει ο Φικ. «Νομίζω ότι αυτό είναι πάντα ένα σημείο έντασης σε αυτές τις παγκόσμιες τεχνολογίες».

Τι μπορούν να κάνουν οι εταιρείες

Θα περάσει αρκετός καιρός πριν η βιομηχανία της τεχνητής νοημοσύνης υποβληθεί σε σημαντικά επίπεδα ελέγχου. Ακόμη και ο νόμος της ΕΕ για την τεχνητή νοημοσύνη, ο οποίος είναι πιο κοντά στην ολοκλήρωση, περιλαμβάνει μια περίοδο χάριτος περίπου δύο ετών μετά τη θέσπιση νόμου για τη συμμόρφωση των εταιρειών.

Ωστόσο, η εκτίμηση της συμμόρφωσης μεταξύ των περιφερειών θα είναι δύσκολη δεδομένης της έλλειψης κοινού ρυθμιστικού πλαισίου. Οι εταιρείες θα πρέπει να εξετάσουν προσεκτικά πώς θα δραστηριοποιούνται σε συγκεκριμένες αγορές και εάν θα τους ζητηθεί να σχεδιάσουν διαφορετικά μοντέλα ή να προσφέρουν διαφορετικές υπηρεσίες για να συμμορφώνονται με συγκεκριμένες περιοχές.

Η Microsoft και η Google δεν έκαναν εικασίες σχετικά με το εάν θα άλλαζαν μοντέλα σε αυτήν την περίπτωση, αλλά δήλωσαν ότι θα προσπαθούσαν να συμμορφωθούν με τους τοπικούς νόμους.

Η Google πρόσφερε μια σύγκριση με τον τρόπο με τον οποίο είχε προηγουμένως τραβήξει ορισμένες υπηρεσίες από χώρες. Μόλις άνοιξε ξανά την προσφορά Ειδήσεων στην Ισπανία πέρυσι, αφού έκλεισε την υπηρεσία πριν από σχεδόν μια δεκαετία λόγω νομοθεσίας που θα ανάγκαζε την εταιρεία και άλλους συγκεντρωτές ειδήσεων να αποζημιώνουν τους εκδότες για μικρά αποσπάσματα περιεχομένου.

Φέτος, η εταιρεία ανέβαλε την κυκλοφορία του chatbot AI Bard στην ΕΕ μέχρι τον Ιούλιο, μετά από μια αρχική καθυστέρηση που προκλήθηκε από τη ρυθμιστική αρχή απορρήτου που εξέφρασε ανησυχίες σχετικά με τον τρόπο προστασίας των δεδομένων των χρηστών. Κυκλοφόρησε στο Ηνωμένο Βασίλειο και τις ΗΠΑ τον Μάρτιο. Η εταιρεία έκανε αλλαγές για να κατευνάσει τις ανησυχίες της ρυθμιστικής αρχής.

Μέχρι να αρχίσει να δαγκώνει ουσιαστικά η νομοθεσία, οι εταιρείες τεχνολογίας θα συνεχίσουν να αυτοαστυνομούνται σε μεγάλο βαθμό. Για αυτούς, αυτό μπορεί να φαίνεται σαν η σωστή σειρά των πραγμάτων – ότι είναι στην καλύτερη θέση να συμφωνήσουν σε νέα πρότυπα για την τεχνολογία καθώς αυτή αναδύεται και αναπτύσσεται, τότε οι ρυθμιστικές αρχές μπορούν να τα κωδικοποιήσουν όταν και εάν είναι απαραίτητο.

Τέσσερις από τις μεγαλύτερες και με μεγαλύτερη επιρροή εταιρείες στον τομέα της τεχνητής νοημοσύνης — Anthropic, Google, Microsoft και OpenAI — ενώθηκαν τον Ιούλιο για να δημιουργήσουν ένα Frontier Model Forum για να συνεργαστούν για το πώς να προωθήσουν την τεχνολογία με υπευθυνότητα.

Αλλά οι ακτιβιστές επισημαίνουν πώς αυτή η προσέγγιση απέτυχε κατά την τελευταία μεγάλη τεχνολογική επανάσταση, με την εμφάνιση των μέσων κοινωνικής δικτύωσης.

Η νομοθεσία που διέπει τα like στο Facebook, το Instagram και το TikTok βρίσκεται ακόμη σε διαδικασία υλοποίησης. Ο Νόμος για τις Ψηφιακές Υπηρεσίες της ΕΕ μόλις αρχίζει να ισχύει τώρα, το νομοσχέδιο για την ασφάλεια στο διαδίκτυο του Ηνωμένου Βασιλείου δεν έχει ακόμη οριστικοποιηθεί μετά από έξι χρόνια και η νομοθεσία των ΗΠΑ για τον τομέα ήταν κυρίως σε κρατικό επίπεδο. Ελλείψει σχεδόν ρυθμιστικού ελέγχου, η παραπληροφόρηση και το επιβλαβές περιεχόμενο έχουν ανθίσει στις πιο δημοφιλείς πλατφόρμες, με λίγες συνέπειες για τους κατόχους τους.

«Σαφώς, η αυτορρύθμιση δεν λειτούργησε», λέει ο Λέσλι, του Ινστιτούτου Alan Turing. «Τόσο μεγάλο μέρος της πολιτικής και κοινωνικής μας ζωής έχει διαμορφωθεί από κάποια από την «προχωρήστε γρήγορα και σπάστε πράγματα» στάση του Silicon Valley, που ήταν εντελώς υπέρ της αυτορρύθμισης. Δεν μπορούμε να συνεχίσουμε να κάνουμε τα ίδια λάθη».